Z czym kojarzy Wam się inteligentny asystent? Pomocną funkcją, która wyśle SMS-a lub wybierze numer? Albo sprawdzi wynik meczu i prognozę pogody? Wszystko jest fajnie, dopóki dysponujecie dostępem do Sieci. Bez Internetu stają się kompletnie bezużyteczni.

To absurdalne, jak działają dziś inteligentni asystenci. Lepiej było na zwykłych komórkach

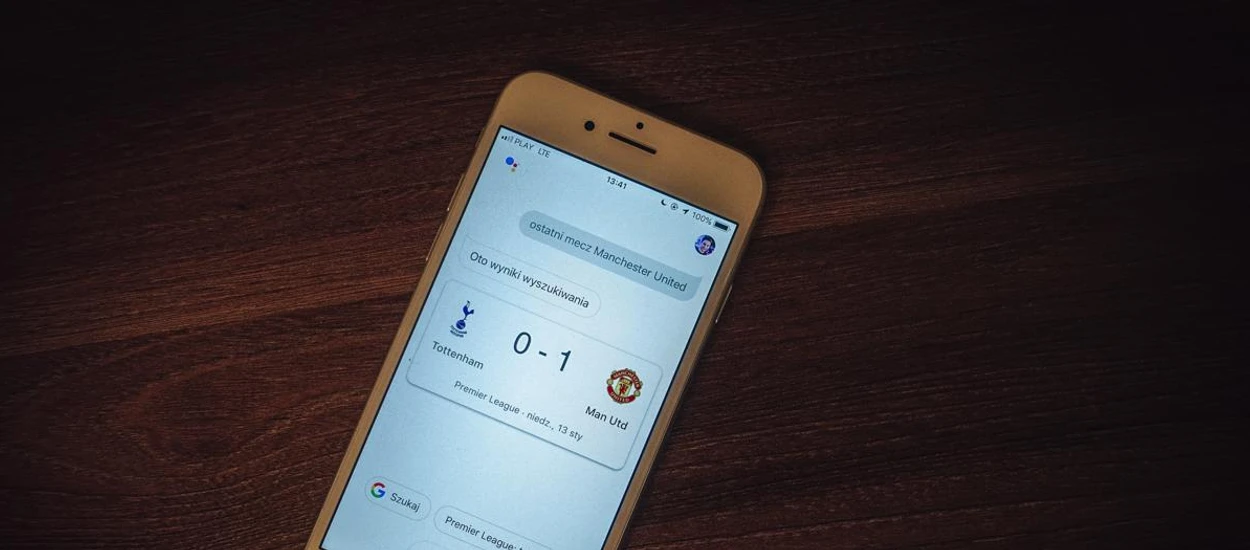

Jak często używacie asystenta głosowego w telefonie? Raz? Dwa? Pięć razy dziennie? A może bezustannie? Mnie zdarza się to dość regularnie, bo właśnie w ten sposób najłatwiej jest czasem zainicjować połączenie, sprawdzić prognozę pogody przed wyjściem z domu, upewnić się co do godziny rozgrywanego przez ulubioną drużynę meczu czy nawet... włączyć latarkę, budzik lub tryb nie przeszkadzać. To wszystko przyspiesza i ułatwia korzystanie z telefonu, bo coraz większą liczbę czynności wykonamy bezwzrokowo i bez sięgania po telefon. W każdej z tych sytuacji musimy spełnić jednak co najmniej jeden, kluczowy warunek - telefon musi mieć połączenie z Internetem. Bez niego Siri i Asystent Google stają się bezużyteczne.

Do czego używacie asystentów głosowych?

W okolicznościach, gdy poszukujemy informacji na temat pogody czy rozgrywek sportowych, taka łączność jest w pełni zrozumiała. Przecież w żaden inny sposób telefon nie będzie w stanie uzyskać potrzebnych szczegółów. To oczywiste. Ale dlaczego, na takim etapie rozwoju technologii, zatrzymaliśmy się w miejscu, gdy wykręcenie numeru lub uruchomienie latarki za pomocą głosu jest niewykonalne bez połączenia z Siecią.

Siri po polsku - realna szansa czy science-fiction?

Pamiętacie jeszcze komendy głosowe w iPhone OS 3 albo nawet protoplastach smartfonów? Mi najczęściej kojarzy się to z telefonami Nokia, gdzie można było skonfigurować system komend głosowych pozwalających na rozpoczęcie połączenia głosowego. Wymagało to kilkukrotnego powtarzania konkretnego zwrotu na przykład "Zadzwoń do Jurka" i przypisywania go do danego kontaktu, ale nikomu nie przyszło wtedy do głowy, by wymagać od użytkowników ciągłego dostępu do Internetu.

Bez Internetu ani rusz

Oczywiście celem istnienia nowoczesnych asystentów głosowych jest możliwość formowania wypowiedzi w zupełnie dowolny sposób, byśmy nie musieli uczyć się na pamięć kilku lub kilkunastu (nie daj Boże kilkudziesięciu) zwrotów o konkretnym brzmieniu, ale w mojej ocenie odrobinę się z tym zapędziliśmy. Jeśli włączenie latarki (ile istnieje wariantów komendy uruchamiającej latarkę?) lub wybranie numeru do konkretnego kontaktu wymaga od nas szybkiego i wydajnego łącza (nie próbujcie korzystać z Siri lub Asystenta Google przy zasięgu w technologii EDGE), to chyba coś jest nie tak, prawda?

Gdzie te wszystkie algorytmy i sztuczna inteligencja, skoro tak rozbudowane układy i systemy operacyjne, jak te, które wylądowały w najnowszych iPhonach, Samsungach czi Pixelach, nie są w stanie poradzić sobie z dość prostymi komendami? Zdaję sobie sprawę, że maksymalnie upraszczam tę sprawę, może nawet przesadzam, ale w takich sytuacjach, jak wcześniej wymienione, trudno mi uwierzyć, że nie możliwe jest skorzystanie z takiego rozwiązania bez przesyłania naszej wypowiedzi do serwerów w celu jej analizy i oczekiwania na odpowiedź z instrukcją dla telefonu.

Siri nie mówi po polsku. Alexa także. Asystent Google jako jedyny przemówił do nas w naszym ojczystym języku. I nie zanosi się na to, by ta sytuacja zmieniła się choćby o jotę w najbliższym czasie, bo następna w kolejce Cortana straciła na znaczeniu do tego stopnia, że Microsoft pozwala na głęboką integrację Alexy z Windowsem i nie tylko. To sprawia, że asystenci głosowi to nadal ciekawostka dla większości Polaków, ale świadomość na temat ich możliwości rośnie.

Hej, jesteśmy na Google News - Obserwuj to, co ważne w techu

![Moda na ciemny motyw nastała. A gdzie niektórzy deweloperzy byli do tej pory? [to mnie wkurza]](https://static.antyweb.pl/img/w_294,h_166/wp-content/uploads/2019/06/25144757/ios13-beta.jpg)