Smartfony to prawdziwie wielofunkcyjne urządzenia, które zastępują wiele innych. W ostatnim czasie sporą popularnością zaczęli się cieszyć asystenci głosowi. Praktyczne aplikacje mogą pomóc nam w m.in. szybkim utworzeniu wydarzenia, sprawdzeniu maila czy też utworzeniu wiadomości, jednak to nie koniec możliwości twórców takich aplikacji. Niedługo Google Pixel 2 pokaże kolejny etap ich rozwoju.

Tę funkcję Google Pixela 2 dotąd pokazywano jedynie na futurystycznych filmikach

Interpretacja otoczenia

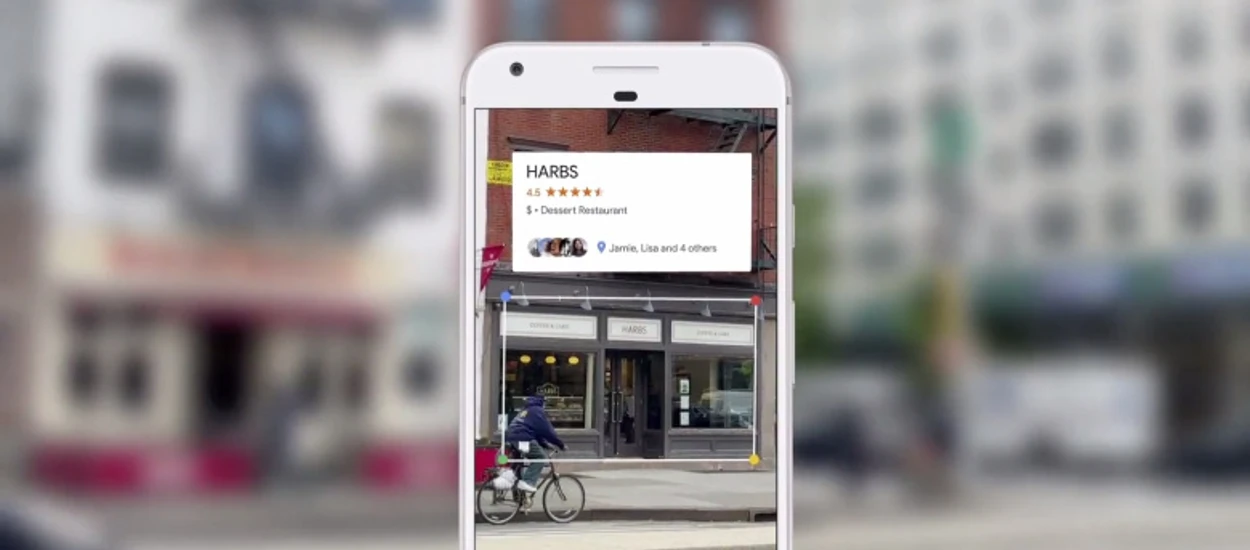

Google Lens to kamień milowy, jeżeli chodzi o aplikacje wykorzystujące systemy sztucznej inteligencji. Aplikacja pozwoli naszemu smartfonowi zrozumieć otaczający go świat. Będzie wystarczyło włączyć aparat, aby nasze urządzeniu zaczęło analizować, jakie sklepy widzi przez matrycęlub jaki gatunek kwiatów właśnie fotografujemy. Jego możliwości w praktyce będą ogromne.

Samo Lens nie jest żadną nowością, ponieważ o programie dowiedzieliśmy się podczas majowej konferencji Google I/O 2017. Doskonałym przykładem jego użyteczności może być wyobrażenie sobie sytuacji, że właśnie wychodzimy na miasto i chcemy coś zjeść. W pobliżu zauważymy przyjemnie wyglądającą restaurację z ogródkiem i kilkoma stolikami odgrodzonymi krzewami od hałaśliwej ulicy. Wyciągamy telefon, uruchamiamy aplikację Google, dzięki której poznamy opinię na temat lokalu, menu oraz ceny. Praktyczne i szybkie, co nie?

Google Lens dla wszystkich

Przynajmniej kiedyś, bo na początku, znając dotychczasowe praktyki Google, zostanie ona zarezerwowana dla nowych przedstawicieli serii Pixel, których poznamy oficjalnie już 4 listopada. Co ciekawsze, Lens bazuje na pewnym znanym Wam programie. Zadebiutował on w 2010 roku, a chodzi tu o Gogle Google – można śmiało powiedzieć, że to jego bezpośredni następca.

Nowość pozwoli na rozpoznanie np. dzieł sztuki, kodów QR, budynków, flag państw, filmów, albumów muzycznych, miejsc, pomników czy gier komputerowych. Gdyby tego było mało, pozwoli na stworzenie kontaktu na podstawie zdjęcia wizytówki, wyszuka informacji o konkretnym produkcie lub zapisze datę z plakatu o nadchodzącym koncercie.

Aplikacja działa dzięki uczeniu maszynowemu. Spodziewam się, że o ile początkowo nie będzie sprawowała się perfekcyjnie, o tyle po kilkunastu miesiącach stażu na rynku konsumenckim, zostanie doprowadzona prawie do perfekcji. W końcu w takim przypadku niezbędne są potężne ilości dane do analizy i nauki dla programu, co jest czym. O to z pewnością już zadbają liczni użytkownicy urządzeń z Androidem.

Wyróżnik Pixela

Apple ma Siri, Samsunga Bixby, a Google Assistanta. Z ostatnim z wymienionych, co nie powinno nikogo dziwić, Lens będzie współpracowało, a o już bliskim debiucie tej aplikacji dowiedzieliśmy się... Dzięki ostatniej aktualizacji Zdjęć Google. W jaki sposób? Otóż deweloperzy znaleźli w niej działający kod jeszcze niedostępnego oficjalnie programu.

Odkrywcy mieli niezwykłą okazję sprawdzić wszystkie opcje nowego programu, jednak poinformowane o wycieku Google szybko naprawiło swój błąd. Obecnie można pobrać Zdjęcia Google bez bardzo ciekawego dodatku. Osobiście nie mogę się już doczekać, kiedy będę mógł sprawdzić działanie Lens w praktyce – szykuje się bardzo przydatny program w podróży i nie tylko.

Zrozumiała rzeczywistość

Project Tango pozwalał na skanowanie świata i tworzenie trójwymiarowych map, np. pomieszczeń. Google Lens to kolejny etap. Nie sztuką jest samo wykonanie obrazu rzeczywistości wokół, a jej poprawna interpretacja – algorytmy sztucznej inteligencji wciąż wymagają w tym zakresie udoskonalenia. Wróćmy jednak jeszcze na chwilę do Pixela. Czy rzeczywiście ta aplikacja będzie jego prawdziwym wyróżnikiem, który zachęci wielu do kupna właśnie jego? Szczerze wątpię, choć ciekawość takimi nowościami potrafi zdziałać cuda.

źródło: xda-developers przez Phone Arena; Wired

Hej, jesteśmy na Google News - Obserwuj to, co ważne w techu