Tegoroczna konferencja Google I/O to prawdziwy festiwal AI – od Androida XR i nowych funkcji Gemini po szalone eksperymenty z multimodalną rzeczywistością. Czym zaskoczy nas Google w nadchodzących miesiącach? Sprawdziliśmy.

Google I/O 2025 – Wszystko, co trzeba wiedzieć

Google na I/O 2025 nie próbowało już nawet udawać, że chodzi tu o Androida czy Chrome’a. Tegoroczne wydarzenie to pokaz siły Gemini i tego, gdzie jeszcze można wcisnąć sztuczną inteligencję. AI nie jest już dodatkiem do usług. Takie algorytmy mogą niedługo stać się fundamentem usług Google. Google I/O 2025 wskazuje na to, że gigant z Mountain View właśnie zaczyna nowy rozdział. Poniżej zebraliśmy wszystkie najważniejsze ogłoszenia.

Tu możecie obejrzeć cały keynote z wczorajszej konferencji:

Gemini Ultra – subskrypcja dla nerdów od AI

Na pierwszy ogień poszedł pakiet Gemini Ultra – dla tych, którzy naprawdę chcą się zanurzyć w świecie AI i mają na to 250 dolarów miesięcznie. W zamian dostajesz m.in. generator wideo Veo 3, aplikację do montażu Flow, dostęp do tzw. trybu „Deep Think” i aż 30 TB przestrzeni w chmurze. Brzmi futurystycznie, ale też trochę jak wersja demo przyszłego systemu operacyjnego Google’a.

Veo 3 i Imagen 4 – AI, które tworzy multimedialną sztukę

Veo 3 potrafi już nie tylko wygenerować film, ale też dorzucić efekty dźwiękowe, tło, a nawet… dialogi. Narzędzie dosłownie potrafi wygenerować materiał wideo z tekstu. Imagen 4 idzie w stronę precyzji – generuje obrazy z detalami jak sierść zwierzaka czy krople wody, i to w bardzo krótkim czasie. Oba modele mają wspierać Flow – nową aplikację AI do wideo, która może już niedługo zawojować TikToka i inne platformy społecznościowe.

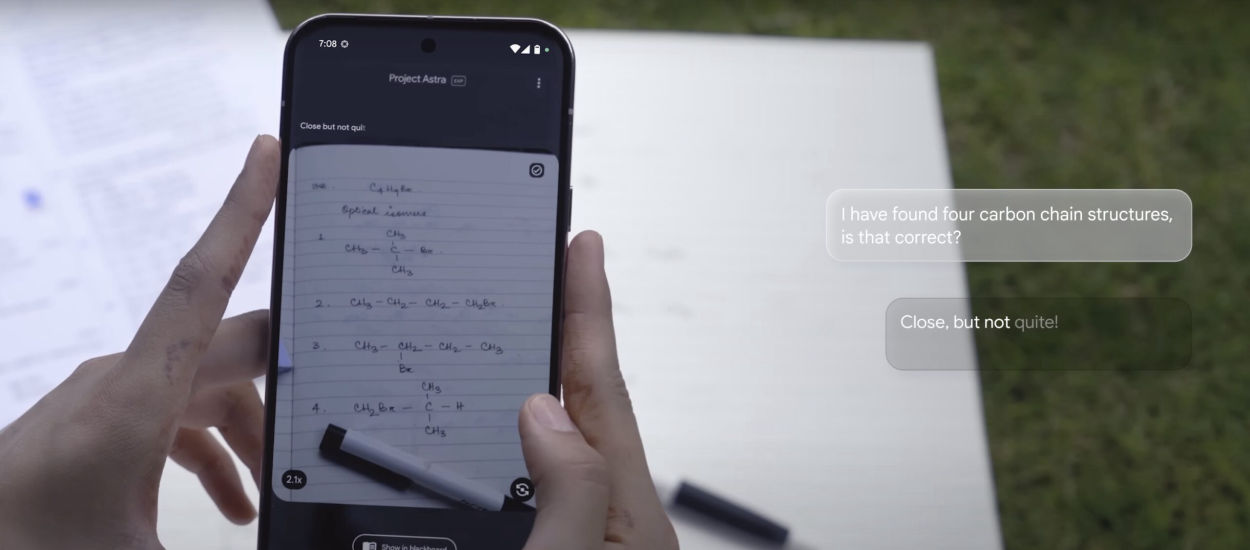

Projekt Astra i „żywe” rozmowy z AI

Myśleliście kiedyś o asystencie AI, który rozumie, co widzi? Project Astra to właśnie ten kierunek. Google pokazało, jak Gemini Live, dzięki kamerze w telefonie, potrafi rozmawiać z użytkownikiem na podstawie tego, co pokazuje mu obiektyw. To jeszcze nie jest Jarvis z Iron Mana, ale kierunek jest jasny – AI ma być „tu i teraz”, nie tylko w chmurze.

Stitch, Jules i Project Mariner – AI dla deweloperów

Google nie zapomniało oczywiście o programistach. W końcu I/O to konferencja dla deweloperów. Stitch to nowa zabawka dla tych, którzy tworzą interfejsy – wpisujesz kilka słów albo wrzucasz obrazek, a on generuje gotowy front-end z HTML i CSS. Jules pomaga ogarniać bugi, a Mariner… sam „przeklikuje się” po internecie. Dosłownie. Kupuje bilety, zamawia jedzenie, porusza się po stronach. To kolejny asystent AI, który pracuje za Ciebie.

Android i Wear OS – tło dla rewolucji AI

To zabawne, że jeszcze do niedawna to właśnie system operacyjny dla urządzeń mobilnych był główną gwiazdą tej konferencji. Na szczęście AI nie zdominowało wydarzenia w 100%. Na Android Show pokazano m.in. Androida 16, który zyska nowy design Material 3 Expressive i funkcje takie jak „Find Hub” z obsługą satelitarną. Wear OS 6 ma lepsze czcionki, dynamiczne motywy i integrację z Gemini. Mobilne systemy były tu jednak tylko tłem. Najważniejsze pytanie brzmi dziś: jak bardzo AI zmieni sposób, w jaki z nich korzystamy?

Gemini w przeglądarce i Gmailu

Gemini trafia do Chrome’a jako asystent przeglądania. Pomoże ogarnąć, co się właściwie dzieje na stronie, albo szybciej coś załatwić. Gmail dostaje „smart replies” (spersonalizowane pisane z myślą o konkretnej osobie), a także funkcję czyszczenia skrzynki. Brzmi jak kosmetyka? Może, ale pokazuje to, jak Google wciska się z AI tam, gdzie jesteśmy niemal codziennie.

Project Beam i komunikacja w 3D

Kojarzycie „Starline”? To projekt badawczy Google, który miał na celu opracowanie technologii wideo powiązanej z innowacyjnym sposobem komunikowania się w sieci. Rozmowy mają wyglądać i brzmieć jak realne spotkania, dzięki renderowaniu obrazu w 3D i dźwiękowi przestrzennemu. No więc Beam to taki Starline. Sześć kamer, śledzenie głowy z dokładnością do milimetrów, AI tłumaczące wypowiedzi w czasie rzeczywistym i zachowujące właściwy ton głosu. Kiedyś będzie to standard – dziś to jeszcze demo, ale i tak robi wrażenie.

NotebookLM, SynthID i reszta ciekawych zabawek

NotebookLM, czyli narzędzie internetowe do prowadzenia badań i robienia notatek, doczekał się aplikacji i możliwości tworzenia streszczeń na poziomie podcastów z platformy NPR. Google wprowadziło też SynthID Detector – usługę do sprawdzania, czy dany obraz lub tekst został stworzony przez AI. Jest też Lyria RealTime – model do tworzenia muzyki za pomocą AI, który można testować przez API.

Android XR – Google wraca do rzeczywistości rozszerzonej

Tak, znowu tam jesteśmy. Po porażkach z Google Glass i Daydream, Google wraca z Androidem XR, tym razem we współpracy z Samsungiem i projektem Moohan. Jeszcze nie wiemy, kiedy narzędzie ujrzy światło dzienne, ale kierunek jest jasny: okulary z Gemini mają być nie tylko „smart”, ale też zintegrowane z ekosystemem sztucznej inteligencji.

Google I/O 2025 nie było typową konferencją dla deweloperów, do jakiej przywykliśmy. Wydarzenie było deklaracją. „Jesteśmy firmą od AI” – zdaje się mówić Google i trudno się z tym nie zgodzić. Nie wszystko działa już dziś, nie wszystko jest do końca zrozumiałe, ale kierunek jest jasny. Ekscytujące? Przerażające? To już temat na inną dyskusję. Jedno jest pewne: po tym I/O świat Google nie będzie już chyba taki sam.

Hej, jesteśmy na Google News - Obserwuj to, co ważne w techu