Pewnie wiecie, że jeżeli chodzi o inteligentnych asystentów głosowych oraz interfejsy oparte na mowie naturalnej, jestem ich ogromnym fanem. Jedno, co mi w nich przeszkadza, to fakt, że trzeba do nich rozmawiać. Na ulicy to wygląda co najmniej "dziwnie" - wielokrotnie, gdy próbowałem konwersować z Asystentem Google na ulicy, przechodnie nie bardzo wiedzieli o co chodzi i pewnie zastanawiali się, czy mam żółte papiery.

Mało tego, nie zawsze bym chciał, żeby inni wiedzieli co aktualnie chcę zrobić w interfejsie głosowym. Obsługa smartfona jest nieco bardziej "intymna" i w tym wyraża się pewna przewaga tego rozwiązania nad bardziej naturalnymi dla nas metodami wydawania komend. A gdyby połączyć "intymność" interfejsu dotykowego z wygodą komend głosowych? Z takiego połączenia powstaje gadżet, za który naprawdę byłbym w stanie zapłacić bardzo dużo.

Komendy głosowe można wydawać "bezgłośnie"

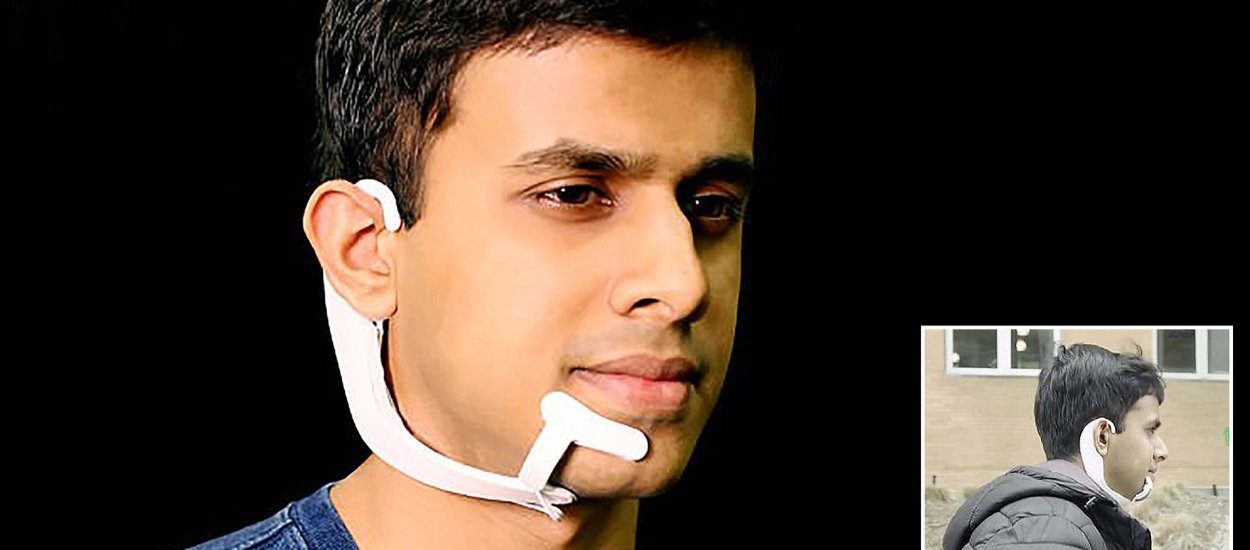

Naukowcy z MIT postanowić sprzęt stanowiący swego rodzaju "przedłużenie" naszych zmysłów, z uwzględnieniem wymaganej intymności interfejsu głosowego. Badacze chcą udowodnić, że da się pogodzić te rzeczy: gadżet miałby być subtelnym sprzętem, który tylko na podstawie tego, co wypowiedzieliśmy sobie "w głowie" tłumaczyłby komendy na zrozumiałe dla urządzenia sygnały. Dzięki temu wcale nie musielibyśmy wyciągać telefonu tylko po to, aby na przykład wybrać konkretny numer - wystarczy, że pomyślelibyśmy: "Zadzwoń do pizzerii", a już po chwili w słuchawce usłyszelibyśmy dźwięk wybierania połączenia.

Naukowcy widzą szansę w tzw. subwokalizacji - zjawisku, z którym walczą m. in. osoby, które uczą się szybkiego czytania. Zastanówcie się, czy czytając konkretny tekst nie próbujecie wokalizować sobie go "w głowie"? Przyznam się Wam, że ja sam, gdy czytam swoje teksty dokładnie "słyszę" swój głos. Dla przykładu:

Gepard powoli zbliża się do swojej ofiary. Doskonale wie o tym, że jeżeli nie uda mu się jej złapać teraz, do końca dnia będzie głodował. W obecnej sytuacji to dla niego być albo nie być.

I pomyślcie teraz o Krystynie Czubównie. Działa? Pewnie, że działa. ;)

Subwokalizacja w kontekście interfejsów głosowych nie jest niestety dobrze zbadana. W tym momencie naukowcom udało się stworzyć zestaw 20 dobrze rozpoznawalnych słów - komend, które pozwalają na konstruowanie na razie nieco mniej zaawansowanych akcji. Dobrze wiadomo o tym, że odpowiednio podłączone elektrody (np. w mięśniach szczęki) są w stanie przejąć odpowiednie sygnały napływające do narządów ruchu. I w trakcie subwokalizacji to również się odbywa, ale bez intencji wykonania czynności związanej z mówieniem. Dla naukowców to szansa na to, aby stworzyć spójny i skuteczny system wprowadzania komend.

Problem leży jednak w tym, aby móc odróżnić pewne sygnały od innych. Zupełnie inaczej przecież sprawa będzie wyglądała, jeżeli zechcemy wypowiedzieć "chleb" lub "chlew". Badacze do tego celu zamierzają wykorzystać sieć neuronową, która będzie uczyła się takich różnic i na ich podstawie kreować "cyfrowy język" dla tak wprowadzanych komend.

Analiza neuromuskularnych sygnałów nie jest rzeczą prostą

Przed naukowcami jest jeszcze długa droga, aż taki gadżet w ogóle zacznie działać tak, jak należy. Dopiero wtedy będzie można na poważnie pomyśleć o wdrożeniu go w środowisku konsumenckim (choć mniemam, że najpierw zainteresuje się nim... wojsko). Trzeba pamiętać o tym, że u różnych użytkowników wzorce neuromuskularnych sygnałów mogą się w pewien sposób różnić - to będzie wymagało kalibracji gadżetu dla konkretnej osoby. A to stwarza już kolejne problemy i znacząco zwiększa koszty wdrożenia.

Niemniej, bardzo się cieszę, że technologia zmierza właśnie w tym kierunku. Jako człowiek, który żywo interesuje się tego typu nowinkami widzę ponadto dla tej metody konkretne zastosowania. Również ludzie, którzy mają problem z mówieniem mogliby dzięki temu w prostszy sposób komunikować się ze światem. Chorzy na ALS (podobnie jak zmarły niedawno Stephen Hawking), czy też na zanik wieloukładowy odzyskaliby szansę na interakcję z otoczeniem.

Hej, jesteśmy na Google News - Obserwuj to, co ważne w techu